本地部署AI大模型 - 个人免费版 - Windows(64位) - GPU- CUDA12.8版

当前版本发布日期:2026-04-08,其中Turnllm默认推理已经同步更新到llama.cpp的最新版(2026-04-08)。

运行量化版AI大模型,下载前检查运行环境和前提:

如何查看:windows系统:开始菜单——点击设置(齿轮图标)——点击“系统”(第一个)——点击“关于”。

操作系统:Windows 10、Windows 11、Windows Server 2022、Windows Server 2025;

系统版本:x64 (64位),(intel、AMD)x86架构(注意:暂不支持arm);

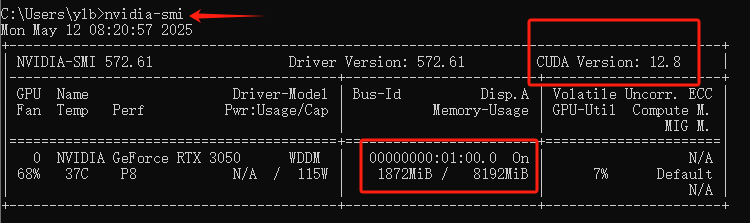

CUDA版本:CUDA 12.8 (GPU版,务必先安装CUDA12.8);CUDA12.8下载地址:

https://developer.nvidia.com/cuda-12-8-1-download-archive?target_os=Windows&target_arch=x86_64

安装好后,使用nvidia-smi命令查看版本信息(务必存在后,再安装本软件,否则无法运行)

物理内存:16GB及以上,DDR4及以上,推荐32GB内存以上,不同模型参数要求不同,单并发建议内存如下:

🚨CPU核心数:1.5B 建议 4核心及以上(intel i5);2B以上,比如:4B、7B,8B 建议 8核心以上(intel i7);8B以上,建议 12核心以上(推荐20核以上, i9-14900K等),32B: 20核心以上;70B:建议至强金牌20核48线程以上处理器。越多越快。

🔑GPU内存建议:GPU内存根据模型和量化版本不同,有所不同,一般7B以下:8GB,7B-14B: 16-24GB(仅供参考建议,实际所需内存与模型推理方式、模型加载的上下文、推理上下文等正相关),实际占用可能与上下文、offload层数等有关。

💡本安装包支持的GPU计算能力架构号为:50,75,80(A30,A100),86(RTX 3050-3090,A10-A40),89(RTX 4050-4090),120a(5090等),详细请参考 https://developer.nvidia.com/cuda/gpus

本参数为运行量化版Q4_K_M的推荐参数。个人版基本够用。本版本为CPU+GPU(CUDA12.8)本地部署推理AI。如果有GPU,可以进行多模态推理(比如图片描述)。

安装视频教程:https://www.zhetao.com/content1606.html

如果您没有英伟达GPU,可下载纯CPU版(点击这里查看安装要求和下载):https://www.zhetao.com/content1599.html

重要提示:下载安装包正式发布,请点击下方按钮下载。在安装过程中遇到问题,请在线客服留言。谢谢。